Fachartikel aus PROTECTOR Special Videoüberwachung 2009, S. 50 bis 53

Blitzschnell geschaltet

Im Vergleich zur analogen Welt entspricht die Funktion eines Netzwerk-Switches innerhalb einer IP-Videolösung in der groben Betrachtung der der klassischen Kreuzschiene. Wie bei einer Kreuzschiene gilt, dass ein Switch nicht gleich Switch ist. Stellt sich die Frage, welche Anforderungen und Entscheidungskriterien sind beim Kauf eines IP-Video tauglichen Netzwerk-Switches wirklich wichtig.

|

| Man kann heute davon ausgehen, dass Switche namhafter Hersteller in der Performance keinen Flaschenhals darstellen. (Bild: Photocase/Nospmpls) |

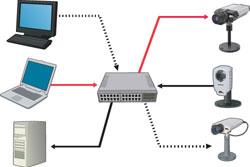

IP-Videolösungen stützen sich auf Standard-Ethernet/IP-Netzwerkinfrastrukturen, die für die Übertragung von Videoströmen genutzt werden. Tragende Elemente einer leistungsfähigen Netzwerkinfrastruktur sind die Netzwerk-Switche, welche im Netzwerk als aktive Verteiler fungieren und die Datenpakete (englisch: Frames) beziehungsweise Videoströme zielgerichtet weiterleiten. Die Weiterleitung der Frames soll möglichst mit hoher Bandbreite und verzögerungsfrei erfolgen.

Switche können sich jedoch auch als Flaschenhals in der Performance herausstellen und für ruckelnde Bilder verantwortlich sein. Des Weiteren können fehlende Features bei der Umsetzung einer IP-Videolösung im Nachhinein funktionelle Einschränkungen herbeiführen. Bei der Umsetzung eines Netzwerkes ist es deshalb äußerst wichtig, dass man die richtige Kaufentscheidung trifft und das Vorhandensein aller notwendigen Features berücksichtigt.

Performance

Ein Netzwerk für eine größere IP-Videolösung besteht üblicherweise aus mehreren Switchen. Die Netzwerkkameras oder Video-Encoder werden in der Regel via TP-Kabel (Twisted Pair, verdrillte Kupferkabel) an so genannte Etagenverteiler angeschlossen.

Da die Segmentlänge eines TP-Kabels auf 100 Meter begrenzt ist, werden diese Switche in etwa 80 bis 100 Meter Reichweite zu den Videoquellen installiert. Diese Switche werden wiederum untereinander sternförmig vernetzt, indem sie über einen so genannten Uplink an einen Backbone-Switch (Backbone: übergeordnete Netzhierarchie, normalerweise ein breitbandiger Hauptstrang) angeschlossen werden.

Die Performance eines Switches zeichnet sich in erster Linie durch die Bandbreite der Netzwerkanschlüsse, der Bandbreite der Backplane-Kapazität und durch die Latenz aus, die bei der Weiterleitung der Frames zum Tragen kommt.

Bandbreite der Netzwerkanschlüsse

Für die Anbindung von Netzwerkkameras oder Video-Encoder wird heute in der Regel ein Netzwerkanschluss genutzt, der mit einer Datenrate von 100 Megabit/Sekunde (Mbit/s) im Vollduplexmodus arbeitet (Vollduplexmodus bedeutet, dass Daten zeitgleich in beide Richtungen geschickt werden können, was mit Performancevorteilen verbunden ist).

Für den Uplink nutzt man hingegen Gigabit-Ethernet-Anschlüsse mit 1.000 MBit/s im Vollduplexmodus, die je nach benötigter Segmentlänge als TP-Interface (maximal 100 Meter) oder LWL-Interface (Lichtwellenleiter, zwei Meter bis zehn Kilometer) ausgelegt sind. Durch die Verwendung von Gigabit-Ethernet wird man der Anforderung gerecht, dass man mehrere Videoströme über diese Verbindungen überträgt.

Geht man für eine „Worst-Case“-Betrachtung von einem Motion-JPEG-Stream in 4CIF-Auflösung mit 30 Bildern/Sekunde aus, so kann man für diesen eine maximale durchschnittliche Bandbreite von acht MBit/s ansetzen (bei MPEG-4 Part 2 wären es in etwa vier MBit/s, und bei H.264 1,6 MBit/s).

Möchte man gleichzeitig mit diesen Bildparametern eine Live-Bildbetrachtung und Aufzeichnung durchführen, so würden zwei dieser Videoströme von der Videoquelle geliefert. Demnach kämen 16 MBit/s zum Tragen, das heißt, die 100-MBit/s-Verbindung zur Videoquelle wäre gerade mal zu 16 Prozent ausgelastet. Betrachtet man den Uplink mit 1.000 MBit/s, so wäre dieser mit 1,6 Prozent ausgelastet.

Geht man von einem Netzwerk-Switch aus, der 24 10/100-MBit/s-Anschlüsse für Endgeräte zur Verfügung stellt, so käme man auf eine Uplink-Auslastung von 38,4 Prozent. Somit gilt für beide Anschlusstypen, dass diese von der Bandbreite her sicherlich keinen Engpass darstellen. Diese Aussage kann zudem in der Praxis gefestigt werden, da man in der Regel nicht mit 30 Bildern/Sekunde aufzeichnet und man auch MPEG-4 oder H.264 verwendet, was nochmals zu einer deutlichen Reduzierung der benötigten Bandbreite führt.

Möchte man auf dem Uplink mehr Bandbreite bereitstellen, so käme auch der Einsatz von Switchen in Betracht, die über einen 10-GBit/s-Uplink verfügen, was allerdings aus heutigem Gesichtspunkt nicht notwendig ist.

Backplane-Kapazität

In der Gesamtbetrachtung ist natürlich interessant, wie viele Frames pro Sekunde der Switch simultan weiterleiten können muss. In diesem Zusammenhang ist die so genannte Non-Blocking-Fähigkeit ein wesentliches Beurteilungskriterium für einen Switch.

|

| Bei einem Netzwerk-Switch werden Daten sehr effizient übertragen, da die Frames zielgerichtet von einem Anschluss zu einem anderen Anschluss geleitet werden. (Bild: Axis) |

Non-Blocking bedeutet, dass ein Switch-Backplane genug interne Bandbreitenkapazität hat, um in der Summe die anstehenden Daten aller Anschlüsse mit höchstmöglicher Geschwindigkeit weiterleiten zu können. Wie viele Verbindungen der Switch dazu simultan bereitstellen können muss, hängt letztendlich von der Anzahl der Anschlüsse ab.

Hierbei gilt, dass der Switch in der Lage sein muss, maximal halb so viele Verbindungen wie er Anschlüsse hat, zeitgleich bereitstellen zu können. Geht man von einem Switch aus, der 24 x 10/100 MBit/s Anschlüsse und 1 x GBit/s Uplink hat, so ergibt sich eine notwendige interne Backplanekapazität von 3,4 GBit/s ((100 MBit/s x 24 x 2 + 1.000 MBit/s x 1 x 2)/2).

Frames pro Sekunde

Des Weiteren sind für die Performancebetrachtung die Anzahl der Frames pro Sekunde entscheidend, für die der Switch die Wegwahl treffen können muss. Die höchsten Anforderungen werden an einen Switch gestellt, falls mit der maximalen Frame-Anzahl gearbeitet wird, die über die Netzwerkleitung übertragen werden kann, was bei kleinster Frame-Größe der Fall wäre.

Betrachtet man die Datenrate von 100 MBit/s, so ergeben sich 148.800 Frames pro Sekunde, die pro Leitung an den Switch heran geführt werden können (bei zehn MBit/s nur 14.880, bei einem GBit/s 1.488.000 und bei zehn GBit/s 14.880.000 Frames/s). Geht man jetzt wieder von dem Beispiel-Switch aus, so müsste dieser in der Lage sein, 5.059.200 Frames/s ((148.800 x 24 x 2 + 1.488.000 x 1 x 2)/2) weiterzuleiten.

Für den Fall, dass der betrachtete Switch eine Backplane-Kapazität von größer gleich 3,4 GBit/s hat und mindestens 5.059.200 Frames/s weiterleiten kann, wird dieser als Non-Blocking bezeichnet und qualifiziert sich somit von der Performance her als IP-Video-tauglich.

Mythos Switch-Latenz

Bei der Weiterleitung der Frames entstehen gewisse Latenzen (Verzögerungen). In den Anfängen der Switch-Ära wurden zu diesem Thema verschiedene Switching- Technologien verglichen, die in der Latenz Vorteile versprachen. Jedoch wurde der Vergleich erschwert, da man bei den unterschiedlichen Switching-Verfahren verschiedene Formen der Darstellung und Messung verwendet hat, sodass ein direkter Vergleich gar nicht möglich war.

Heute kann man davon ausgehen, dass ein Switch nach dem so genannten Cut-Through-Verfahren arbeitet. Hinzu kommt, dass die meisten auf dem Markt erhältlichen Switche auf der selben Chipsatzfamilie basieren, die von einem namhaften Hersteller aus der Halbleiterbranche hergestellt wird. Dadurch ergibt sich die Situation, dass man, bezogen auf die Latenz, von typischen Werten ausgehen kann, welche wie folgt aussehen:

- 100 MBit/s: < 35 Mikrosekunden (µs) (FIFO 64-Byte-Frame),

- 1.000 MBit/s: < 3,7 µs (FIFO 64-Byte-Frame),

- 10 GBit/s: < 2,1 µs (FIFO 64-Byte-Frame).

Neben der Performance ist die Unterstützung zahlreicher Protokolle und Features sinnvoll, damit sich der Switch für die professionelle Nutzung innerhalb eines IP-Video-Netzwerks bevorzugt eignet.

Die Frage der Layer

Die Kommunikation innerhalb eines Netzwerks wird allgemein über das OSI-Referenzmodell beschrieben, das in sieben Teilschichten (Layer) unterteilt ist. Jeder Layer beschreibt bestimmte Funktionen, welche einen Beitrag bei der Kommunikation beziehungsweise dem Datenaustausch liefern.

Die Funktion eines Switches entspricht per Definition denen des 2. Layers, das heißt Switche, welche keine zusätzlichen Funktionen einer höheren Ebene unterstützen, werden im Fachjargon als Layer-2-Switche bezeichnet. Es gibt jedoch auch Switche, die beispielsweise zusätzlich ein Routing unterstützen, also auch auf dem 3. Layer arbeiten und Daten zwischen verschiedenen IP-Netzen weiterleiten können. In diesem Fall spricht man von einem Layer-3-Switch.

Betreibt man ein Netzwerk, dass in verschiedene IP-Netze unterteilt ist, so ist es notwendig, Layer-3-Switche einzusetzen, falls die Switche die Datenweiterleitung zwischen den verschiedenen IP-Netzen übernehmen sollen. Andernfalls wären Router erforderlich, die diese Aufgabe wahrnehmen.

Entscheidender Vorteil beim Routing durch ein Layer-3-Switch ist, dass dieser in der Regel die Daten schneller weiterleiten kann als ein Router. Hierzu verwenden die Layer-3-Switche einen kleinen Trick, indem bei einem wiederholten Routing über die selbe Strecke nicht mehr geroutet wird, sondern auf das schnellere Switching übergegangen wird. Dies ist besonders bei IP-Video-Infrastrukturen vorteilhaft.

Des Weiteren gibt es auch so genannte Layer-4-Switche, die auf dem vierten Layer eine Priorisierung anhand der genutzten TCP/UDP-Port-Nummern realisieren können. Port-Nummern werden im Netzwerkbereich verwendet, um bestimmte Dienste zu adressieren.

Im IP-Video-Bereich kommt diese Priorisierung in der Regel weniger zum Tragen, da sie allgemein größere Verzögerungen hervorruft, welche die zusätzliche Auswertung auf dem vierten Layer verursacht. Im Bereich IP-Video werden demnach bevorzugt Layer-2- oder Layer-3-Switche eingesetzt.

Switch als Router

Möchte man die Routing-Funktion eines Switches nutzen, so ist entscheidend, welches Routing-Protokoll der Switch unterstützt. Gängige Protokolle im Netzwerkbereich sind RIP (Routing Information Protocol) und OSPF (Open Shortest Path First). Beim RIP handelt es sich um ein relativ einfaches Routing-Protokoll, wohingegen OSPF einige optimierte Funktionen bietet, mit denen beispielsweise kürzeste Verbindungswege zwischen verschiedenen Routern in kürzester Zeit ermittelt werden können.

Geht man in die Detailbetrachtung der Layer-3-Switche rein, so fällt auf, dass Low-Cost Layer-3-Switche oft nur RIP unterstützen. Diese Switche werden deshalb oft auch nur als Layer-2+ oder Layer-3- Switche bezeichnet. Hier ist also bei der Produktauswahl Vorsicht geboten.

IPv4 versus IPv6

Das Internet Protocol gibt es in zwei Versionen, in Version 4 (IPv4) und Version 6 (IPv6). Wesentlicher Unterschied zwischen IPv4 und IPv6 ist die Anzahl der möglichen IP-Adressen. IPv4 bietet eine Adresslänge von 32 Bit und IPv6 von 128 Bit. Somit lassen sich unter IPv6 viel mehr Adressen vergeben, als bei IPv4.

Derzeit wird IPv4 noch primär innerhalb eines Netzwerks eingesetzt, jedoch ist langfristig die Ablösung durch IPv6 geplant. Für die Anschaffung von Netzwerkkomponenten bedeutet dies, dass man generell beim Neukauf prüfen sollte, ob die Geräte bereits auch IPv6 unterstützen. Ein Layer-3-Switch sollte auf jeden Fall IPv6 unterstützen, damit die Routing-Funktion unter der neuen IP-Version auch genutzt werden kann.

Power-over-Ethernet-Unterstützung

Ein nicht zu unterschätzender Vorteil von IP-basierten Videolösungen ist die Möglichkeit, die Stromversorgung von IP-Kameras via Power over Ethernet (PoE) zu realisieren. Dies erspart am Installationsort der Kameras die Bereitstellung einer Spannungsversorgung und bietet die einfache Implementierung einer zentralen Absicherung gegenüber Spannungsausfällen, welche auf natürliche Art und Weise auftreten können oder im Rahmen eines Sabotageversuchs.

Moderne Switche bieten die Möglichkeit, als Stromquelle zu fungieren, das heißt an ihren Netzwerkanschlüssen die PoE-Spannungsversorgung bei Bedarf bereitzustellen.

Möchte man diese Möglichkeit nutzen, so gilt es zu prüfen, wie viel Leistung ein Switch an seinen Anschlüssen in Summe bereitstellen kann. Nach dem heutigen IEEE-802.3af-Standard können über einen Anschluss maximal 15,4 Watt eingespeist werden, wobei dann über die maximal zulässige Leitungslänge von 100 Meter 12,95 Watt für das Endgerät als garantierte Maximalleistung zur Verfügung stehen.

Oft ist es so, dass ein Switch nicht auf allen Anschlüssen die maximale Leistung zur Verfügung stellen kann. Es gibt auch modulare Switche, die über eine Option für ein zweites Netzteil verfügen, durch dessen Bestückung dann die volle Leistung an allen Anschlüssen bereitgestellt werden kann. Auf jeden Fall sollte man das Leistungsbudget des Switches mit der Leistungsaufnahme der Endgeräte abgleichen und sicherstellen, dass ein Switch in Summe die notwendige Leistung zur Verfügung stellen kann.

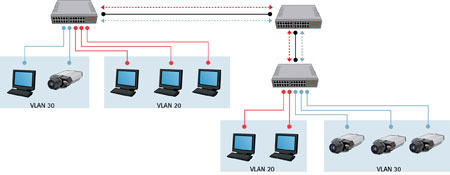

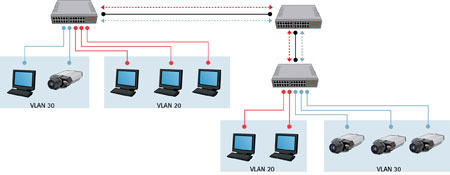

VLAN

Bei kleineren bis mittleren IP-Videolösungen ist man bestrebt, das vorhandene Netzwerk für die Videoübertragung mit zu verwenden. In diesem Fall bietet es sich an, das vorhandene physische Netzwerk durch die VLAN-Technologie (Virtuelles LAN) in logische Netzwerke zu unterteilen. Nur Teilnehmer, welche zum selben virtuellen LAN gehören, können in diesem untereinander Daten austauschen und auf Ressourcen innerhalb desselben VLANs zugreifen.

|

| VLANs können über mehrere Switches hinweg gebildet werden, wodurch sich größere Netzwerke segmentieren lassen. (Bild: Axis) |

Hiermit lässt sich also eine sichere Trennung zwischen einem Office-Netzwerk und dem Video-Netzwerk erzielen, obwohl im selben Netzwerk gearbeitet wird. Auf diese Weise wird man zusätzlich den Anforderungen gerecht, dass unberechtigte Personen keinen Zugriff auf die übertragenen und gespeicherten Videos erhalten können.

Quality of Service

Betreibt man mehrere Dienste in einem Netzwerk, so kann es sinnvoll sein, dass man die unterschiedlichen Daten im Netzwerk mit verschiedenen Prioritäten überträgt. So ist es beispielsweise bei der IP-Telefonie (VoIP, Voice over IP) äußerst wichtig, dass die Datenströme möglichst verzögerungsfrei und ohne große Varianz in der Verzögerung übertragen werden, damit die Sprachqualität sichergestellt ist. An dieser Stelle greift QoS (Quality of Service), mit dem eine Priorisierung der unterschiedlichen Daten erzielt werden kann. QoS kann auf Layer 2 (Ethernet-Ebene) oder Layer 3 (IP-Ebene) implementiert sein, wobei letzteres am gebräuchlichsten ist.

IEEE-802.1q und 802.1p

VLAN und QoS auf Ethernet-Ebene basieren auf dem IEEE-802.1Q- und IEEE-802.1p-Standard. 802.1q definiert ein erweitertes Format eines Ethernet-Frames, in dessen verlängerter Header zusätzliche Felder für die Kennzeichnung der verschiedenen VLANs und der Priorisierung beinhaltet sind.

Über das so genannte VLAN-ID-Feld können die übertragenen Daten gekennzeichnet werden, damit diese Switche-übergreifend innerhalb der jeweiligen VLANs weitergeleitet werden können. Des Weiteren beschreibt IEEE-802.1p verschiedene Priorisierungen, mit denen die Daten gekennzeichnet werden können und mit deren Hilfe die Weiterleitung gesteuert werden kann.

QoS auf Layer 3

Für Qos auf der IP-Ebene wird das so genannte DSCP (Differentiated Service Codepoint) verwendet. Hierbei handelt es sich um ein Flag, über das gekennzeichnet werden kann, zu welcher Art die Daten im jeweiligen IP-Paket gehören. Anhand dieses Flags werden die Datenpakete in Traffic-Klassen eingeteilt und je nach Klasse bei der Weiterleitung priorisiert behandelt.

Bei der Priorisierung können insgesamt acht verschiedene Klassen genutzt werden, um die Daten einzuteilen. Voraussetzung für die Nutzung von QoS ist, dass die Switche die Anforderungen nach RFC 2474 unterstützen (RFC: eine Sammlung von Dokumenten über Internet-Standards, -Protokolle und -Verfahren).

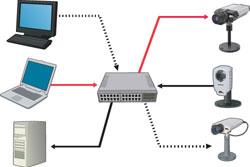

802.1X-Authentifizierung

Im Bereich IP-Video kommt es immer wieder vor, dass Netzwerkkabel zwecks Kamerabindung in einen öffentlichen Bereich, wie beispielsweise Parkplätze oder Hallen von Shoppingmalls verlegt werden müssen.

|

|

Die IEEE 802.1X-Authentifizierung bietet eine Anschluss-basierte Sicherheit und umfasst einen Supplicant (z.B. eine Netzwerkkamera), einen Authenticator (z.B. einen Switch) und einen Authentifizierungsserver. (Bild: Axis) |

Hierdurch ergibt sich jedoch die Gefahr, dass potentielle Eindringlinge über diese Anschlüsse versuchen könnten, auf das Netzwerk zuzugreifen, indem sie das Netzwerkkabel von der Kamera abziehen, an ihrem Notebook anschließen und über diesen Weg auf das Netzwerk zugreifen. Verlässlichen Schutz dagegen bietet die IEEE-802.1X-Authentifizierung, die heute von vielen Netzwerkkameras, Video-Encodern und Switchen unterstützt wird.

Zudem wird ein Radius-Server (Remote Authentication Dial-In User Service) benötigt, gegen den sich die angeschlossenen Endgeräte authentifizieren können. Erst wenn die Authentifizierung erfolgt ist, werden logische Ports am Switch geöffnet und Nutzdaten können über den jeweiligen Netzwerkanschluss übertragen werden.

Auf diese Art und Weise wird verhindert, dass fremde Endgeräte am Netzwerk betrieben werden können, mit denen ein Ausspähen der Daten möglich wäre. Sobald also Netzwerkkabel außerhalb eines geschlossenen Gebäudes verlegt werden müssen, ist es vorteilhaft, wenn Switche den IEEE-802.1X-Standard unterstützen und die zuvor beschriebene Authentifizierung umgesetzt werden kann.

Multicast-Fähigkeit

Für das Abrufen von Videos an Netzwerkkameras oder Video-Encodern gibt es zwei Möglichkeiten, entweder Unicast oder Multicast. Arbeitet man im Unicast, so wird jede Station einen dedizierten Videostrom von der Videoquelle abrufen, das heißt mit jeder Station wird beispielsweise eine Netzwerkkamera zusätzlich belastet, und die notwendige Bandbreite steigt.

Alternativ gibt es die Möglichkeit, im Multicast zu arbeiten. Hierbei wird nur ein Videostrom von der Videoquelle abgerufen und dieser an alle Stationen versendet, die zu einer Multicast-Gruppe gehören. Der Sender von Multicast-IP-Paketen weiß in diesem Fall nicht, welche und wie viele Stationen seinen Videostrom empfangen. Denn er verschickt nur einen einzigen Videostrom an seinen übergeordneten Switch. Dieser dupliziert die IP-Pakete bei Bedarf, wenn er mehrere ausgehende Empfängerstationen hat.

Die Nutzung von Multicast ist besonders vorteilhaft, wenn eine größere Anzahl von Stationen zeitgleich einen Videostrom abrufen möchte. Umgesetzt wird Multicast über das IGMP (Internet Group Multicast Protocol) und PIM (Protocol Independent Multicast). Mit Hilfe des IGMP kann eine Station einem Switch mitteilen, dass sie Multicast-IP-Pakete von einer bestimmten Multicast-Gruppe empfangen möchte.

Die Weiterleitung der Multicast-IP-Pakete erfolgt über das PIM, das ein Routing von Multicast-Paketen im Netzwerk und Internet ermöglicht. IGMP ist in RFC 3376 beschrieben und PIM in verschiedenen Modi in RFC 3973 und RFC 4601. Möchte man Multicast nutzen, so sollten die verwendeten Switche diese Protokolle nach den RFCs unterstützen.

Kein Flaschenhals

Man kann heute davon ausgehen, dass Switche namhafter Hersteller in der Performance keinen Flaschenhals darstellen. Im Low-Cost-Bereich ist es hingegen sinnvoll, sich sorgfältig mit den Angaben in den technischen Datenblättern auseinanderzusetzten. Des Weiteren sind die vorhandenen Features entscheidend, welche von Fall zu Fall geprüft werden sollten.

Jörg Rech, Technical Trainer & Consultant bei der Axis Communications GmbH

Jörg Rech ist Autor zweier Bücher:

- „Ethernet – Technologien und Protokolle für die Computervernetzung“, 2., aktualisierte und überarbeitete Auflage, Dezember 2007, ISBN 978-3-936931-40-2

- „Wireless LANs – 802.11-WLAN-Technologie und praktische Umsetzung im Detail“, 3., aktualisierte und erweiterte Auflage, Mai 2008, ISBN 978-3-936931-51-8